Praxiseinblicke in die Berichterstellung mit Generativer Künstlicher Intelligenz

Hingegen zeigt GenAI auch für aktuarielle Tätigkeiten ein erhebliches Potenzial, wie beispielsweise der Berichterstellung – oder auch Wissensassistenten für aktuarielle Themen. Die Berichterstellung ist in vielen Unternehmen geprägt von wiederkehrenden Mustern, hohem Zeitdruck, heterogenen Datenquellen und zahlreichen Iterationen mit internen sowie externen Stakeholdern. Typische Beispiele sind Ergebnisberichte, interne Risiko berichte, ORSA-Bericht, Text- und Analysebausteine in Geschäftsberichten sowie Solvency-II-Narrative im SFCR und RSR. Ergänzend hinzu kommen beispielsweise Technische Berechnungsgrundlagen sowie Nachhaltigkeits- und ESG-bezogene Textbausteine mit quantitativen Bezügen. In der Praxis geht es dabei in der Regel nicht um eine voll ständige Automatisierung eines gesamten Berichts mittels GenAI, sondern vor allem um die effiziente Erstellung und Harmonisierung der narrativen, erklärenden Textteile (z. B. Treiberkommentare, Management Summary, Einordnungen von Abweichungen). Andere Berichtsteile – insbesondere Tabellen, standardisierte Kennzahlenblöcke oder sehr ein fache, deterministische Satzbausteine – lassen sich häufig weiterhin besser durch klassische Programmierung, Automatisierung oder regelbasierte Texterzeugung abbilden und sollten daher unverändert in diesen bewährten Ver fahren verbleiben.

Ein praxistauglicher GenAI-Einsatz folgt einem klar definierten Prozess: Validierte Inputdaten und freigegebene Quellen bilden die Basis, das LLM erstellt daraus einen Entwurf, der vom „Human-in-the-Loop“ fachlich geprüft und freigegeben wird. Der vorliegende Artikel beleuchtet, wie GenAI in diesem Umfeld eingesetzt werden kann, welche Benefits realistisch sind, welche Herausforderungen beachtet werden müssen und welche Lösungsansätze sich in der Praxis für eine erfolgreiche, nachhaltige und skalierbare Umsetzung bewährt haben.

Benefits

In der Berichterstellung zielt der Einsatz von GenAI selten darauf ab, Berichte vollständig automatisiert zu erzeugen. Eine solche vollautomatische End-to-End-Generierung würde faktisch eine Black-Box-Berichterstellung bedeuten, deren Entstehungslogik nur begrenzt nachvollziehbar ist und die den fachlichen sowie regulatorischen Anforderungen nicht genügt. Im Fokus steht daher die Erstellung eines robusten, fachlich korrekten und qualitativ hochwertigen Entwurfs, der als solide Grundlage für die menschliche Prüfung dient. GenAI unterstützt insbesondere bei wiederkehrenden Textbausteinen, einer konsistenten sprachlichen Ausgestaltung und der strukturierten Vorarbeit für den Review. Unter klar definierten Leitplanken entstehen so hochwertige Entwürfe, die anschließend von Expertinnen und Experten finalisiert werden. Im Folgenden skizzieren wir die zentralen Vorteile, die sich in der Praxis regelmäßig beobachten lassen.

Zeitersparnis und schnellere Iterationen

GenAI kann wiederkehren de Textpassagen – etwa Standardformulierungen, Übergänge, Management Summary-Varianten oder tochtergesellschaftsspezifische Absätze – auf Basis strukturierter Eingaben wie konkrete Formulierungen, Zahlen, Treibern und Argumentationsstichpunkten deutlich schneller erzeugen als ein vollständig manueller Prozess. Durch die hohe Skalierbarkeit der Anwendung verstärkt sich der Effekt bei Versicherungsgruppen mit vielen Einheiten – die Erstellung pro rechtlicher Einheit lässt sich beispielsweise standardisieren und Iterationen nach Zahlen- oder Argumentationsupdates können signifikant schneller erfolgen.

Konsistente Sprache und einheitlicher Stil über Autoren und Perioden

Berichtstexte entstehen häufig verteilt über verschiedene Teams, Autoren und Zeithorizonte. GenAI kann – bei Verwendung eines Styleguides und konsistenter Prompt-Vorlagen – eine gleichförmige Tonalität, Terminologie und Satzstruktur unterstützen. Das erhöht Lesbarkeit und Professionalität und reduziert Reibungsverluste im Review („klingt anders als letztes Jahr“).

Reduktion formaler Fehler (Rechtschreibung, Grammatik, Tippfehler)

Gemäß Konstruktion sind LLMs in der Lage, sprachliche Unsauberkeiten, uneinheitliche Schreibweisen oder holprige Formulierungen zu erkennen und zu verbessern. In der Praxis reduziert dies den manuellen Korrekturaufwand – insbesondere in späten Phasen, in denen sich Teams eigentlich auf Inhalte statt auf Formalien konzentrieren sollten.

Unterstützung bei struktureller Kohärenz und „Storyline“

Viele Berichte scheitern weniger an der reinen Faktenlage als an der klaren Einordnung: Was ist die zentrale Botschaft, welche Treiber sind relevant, wie werden Abweichungen verständlich erklärt? GenAI kann helfen, aus Stichpunkten oder Treiberlisten eine nachvollziehbare Argumentationskette zu formulieren – inklusive sinnvoller Übergänge zwischen Abschnitten.

Skalierbares Upskilling und Einstiegspunkt für weitere Use Cases

Berichterstellung eignet sich häufig als „Einstiegsan wendungsfall“, um Mitarbeitende an den produktiven Umgang mit GenAI heranzuführen: Prompting, Qualitätskriterien, Review-Disziplin, Tool-Integration und Governance werden greifbar. Dieses Know-how lässt sich später auf weitere Anwendungsfälle übertragen, etwa auf Treiber- und Abweichungsanalysen, die Unterstützung von Bestandsmigrationen durch Analyse und Dokumentation von Legacy-Code sowie dessen Übersetzung in moderne Programmiersprachen, und auf LLM-gestützte Fachassistenten im Aktuariat oder in Underwriting- und Schadenprozessen.

Übertragbarkeit auf andere Berichtstypen und Dokumentklassen

Ein einmal etabliertes Vorgehen (Templates, Glossar, Daten-Schnittstellen, Prüfregeln) kann auf weitere Dokumente adaptiert werden, z. B. technische Berechnungsgrundlagen in der Krankenversicherung, Methodik-/ Migrationsbeschreibungen, interne Richtlinien oder Nachhaltigkeitsberichte mit quantitativen Bezügen. Entscheidend ist hierbei weniger der konkrete Berichtstyp als die Wiederholbarkeit der Struktur und die Verfügbarkeit verlässlicher Eingabedaten. Ein einmalig definiertes Gerüst ist somit hochgradig skalierbar und reduziert Folgeaktivitäten.

Automatisierte Qualitätssicherung nach Erstellung

GenAI kann auch im Review-Prozess unterstützen: Ein fertiger Entwurf lässt sich automatisiert auf verschiedene Fehlerklassen prüfen – sprachliche Fehler (z. B. Rechtschreibung), inhaltliche Inkonsistenzen (z. B. widersprüchliche Aussagen), strukturelle Fehler (z. B. falsche Verweise auf Kapitel/Tabellen) oder Layout-/ Formatierungsinkonsistenzen (z. B. unterschiedliche Schreibweisen von Kennzahlen). Besonders wirksam ist dies, wenn die Prüfung regelbasiert ergänzt wird (z. B. verpflichtende Begriffe, erlaubte Abkürzungen, „Do/ Don’t“-Listen).

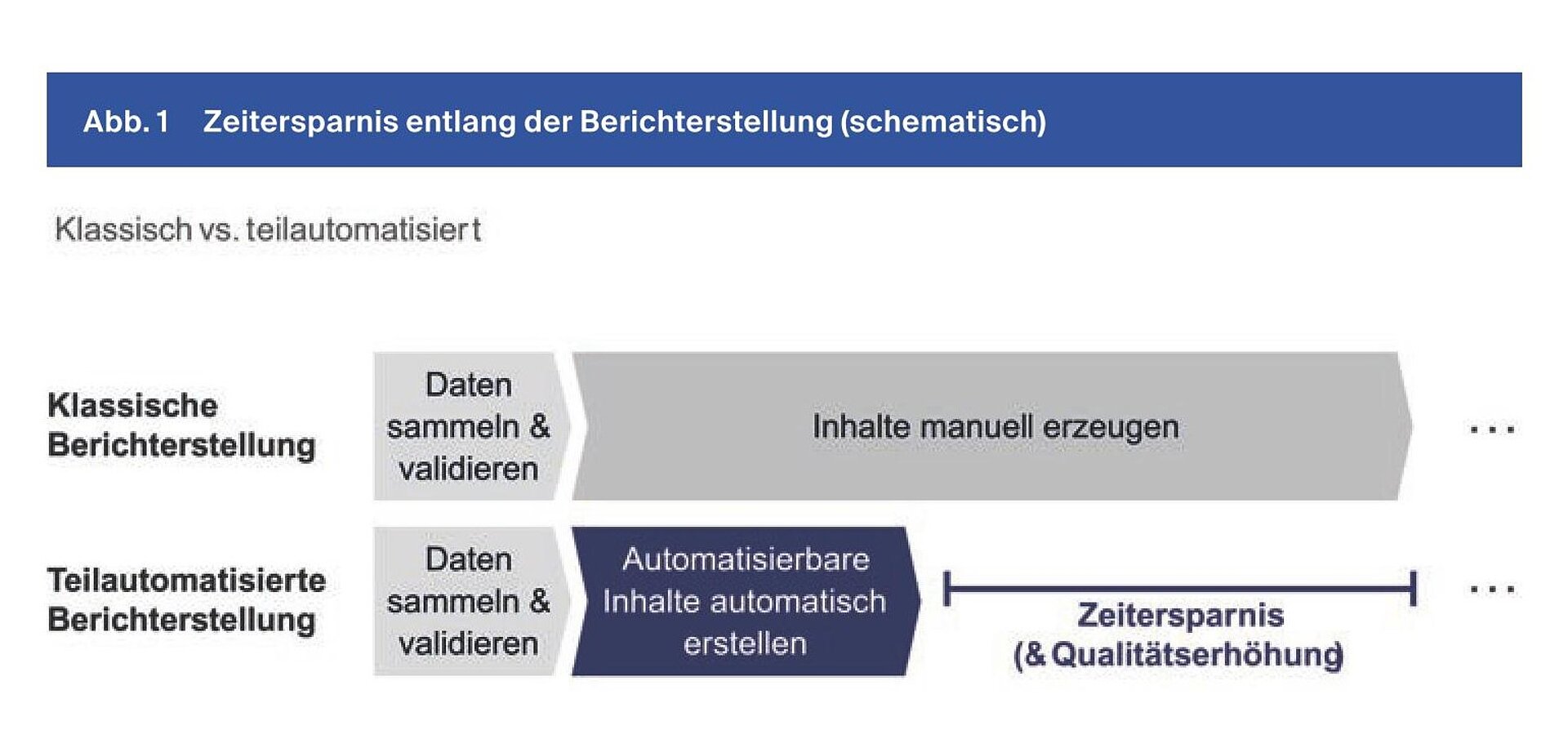

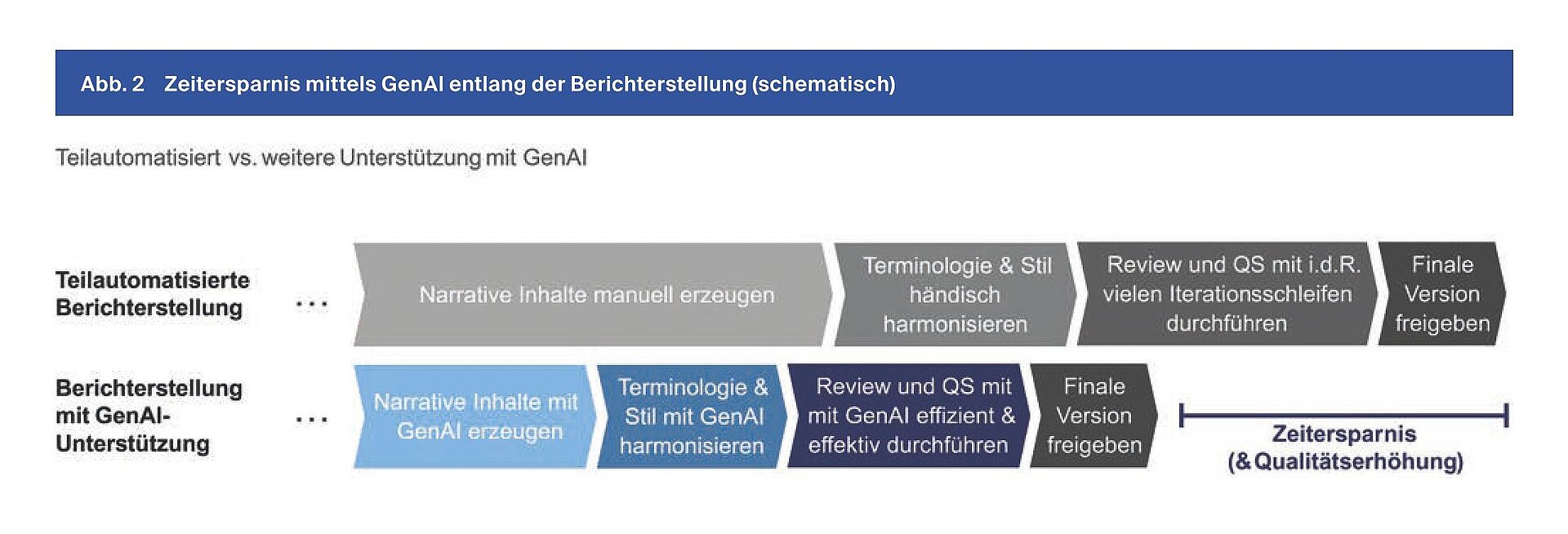

Eine teilautomatisierte Berichterstellung von Inhalten – wie in Abbildung 1 dargestellt – führt bereits zu einer spürbaren Zeitersparnis und einer höheren Ergebnisqualität für den ersten Prozessschritt der Berichterstellung. Dieser Mehrwert lässt sich durch eine GenAI-unterstützte Berichterstellung nochmals deutlich steigern, wie in Abbildung 2 veranschaulicht wird.

Herausforderungen

Trotz der genannten Vorteile ist GenAI kein Plug-and-Play Werkzeug. Gerade im aktuariellen Kontext gelten hohe Anforderungen an Korrektheit, Nachvollziehbarkeit, Ver-

traulichkeit und Reproduzierbarkeit. Dabei ist besonders hervorzuheben, dass konkrete Berechnungen exakt durch geführt werden müssen – was LLMs per Konstruktion nicht leisten können. Umso wichtiger ist die Bestimmung von geeigneten Leitplanken, um Fehlern entgegenzuwirken, die fachlich schwerwiegend sein können oder erst spät auffallen. Die wichtigsten Herausforderungen seien im Folgenden genannt:

Probabilistische Ausgabe und eingeschränkte Reproduzierbarkeit

LLMs erzeugen Text stochastisch: Gleicher Input kann zu unterschiedlichen Outputs führen – insbesondere bei kreativerer „Temperatur“-Konfiguration oder wenn der Prompt Interpretationsspielraum lässt. Für Reporting-Prozesse, die über mehrere Iterationen hinweg konsistent bleiben müssen, ist das eine zentrale Herausforderung. Abhilfe schaffen klare Vorlagen, restriktive Parametrisierung, feste Prompt-Templates und ein standardisiertes Vorgehen mit Versionierung. Es gilt die Varianz im Output zu reduzieren.

Begrenzte Rechenfähigkeit und Risiko überzeugen der Rechenfehler

LLMs sind primär Textmodelle. Sie können zwar Rechenschritte sprachlich plausibel „erklären“ – gar mathematisch komplexe Aufgaben durch geschickte Herleitungen und Erkennen von Zusammenhängen lösen –, sind aber bei konkreten deterministischen Operationen (etwa bei Divisionen, Rundungen, Aggregationen) fehleranfällig. In Reporting-Kontexten ist das kritisch, weil falsche Zahlen oft sehr überzeugend formuliert werden („halluzinierte Präzision“). Daher sollten Berechnungen und Zahlenauswertungen konsequent durch deterministische Tools (z. B. via Function Calling) erfolgen und vom LLM nur sprachlich eingeordnet werden.

Halluzinationen und faktische Ungenauigkeiten

LLMs können Inhalte erzeugen, die grammatikalisch korrekt wirken, aber sachlich falsch sind – etwa erfundene Ursachen, nicht vorhandene Ereignisse oder unzulässige Schlussfolgerungen aus Daten. Besonders riskant ist dies bei Treiberanalysen („Das war hauptsächlich wegen X“), wenn X nicht eindeutig aus den Inputs ableitbar ist. Hier braucht es klare Regeln: Was darf das Modell interpretieren, was muss es wörtlich aus Quellen übernehmen, und wo muss es Unsicherheit transparent machen?

Fachterminologie, Abkürzungen und Mehrdeutigkeiten

Versicherungsspezifische Begriffe, lokale Abkürzungen oder organisationsinterne Definitionen sind für allgemeine LLMs nicht immer eindeutig. Akronyme können je nach Kontext falsch interpretiert werden, und scheinbar „kleine“ Abweichungen in der Terminologie können fachlich bedeutsam sein. Ohne Glossar, Definitionshoheit und Begriffsdisziplin steigt das Risiko subtiler inhaltlicher Fehler.

Akzeptanz bei Stakeholdern und Verantwortlichkeit („Human-in-the-Loop“)

Selbst wenn GenAI technisch funktioniert, muss sie in den Prozess passen: Wer trägt Verantwortung, wer unterschreibt fachlich, wie werden Änderungen kommuniziert, und wie wird verhindert, dass ein „KI-Output“ ungeprüft in finale Dokumente gelangt? Reporting bleibt ein verantwortungskritischer Prozess – GenAI ist ein mächtiges Werkzeug, keine verantwortliche Instanz.

Datenvertraulichkeit, Datenschutz und Informationssicherheit

Berichte enthalten häufig vertrauliche Geschäftsdaten. Je nach Implementierung (Cloud vs. On-Prem, Anbieter, Vertragslage, Logging, Datenhaltung) ergeben sich An forderungen an Datenschutz und Informationssicherheit. Zusätzlich ist zu klären, ob Inhalte in externe Systeme übertragen werden dürfen, wie Prompt- und Output Daten gespeichert werden und wer Zugriff hat. Ohne klare Governance kann ein fachlich guter Use Case organisatorisch scheitern.

Nachvollziehbarkeit, Audit-Trail und Governance Anforderungen

In vielen Organisationen müssen Berichte nicht nur „richtig“, sondern auch nachvollziehbar entstanden sein: Welche Datenquelle lag zugrunde, welche Version wurde verwendet, wer hat einen Review durchgeführt, welche Änderungen wurden wann vorgenommen? GenAI kann diesen Audit-Trail erschweren, wenn Prompts und Mo dellversionen nicht systematisch dokumentiert werden. Für eine robuste Nutzung sind daher Logging, Versionie rung und definierte Freigabeprozesse essenziell.

Lösungsansätze

Die genannten Herausforderungen lassen sich in der Praxis sehr gut meistern, wenn GenAI als klar definiertes und kontrolliertes Element in einen strukturiert gestalteten Reporting-Prozess eingebettet wird. Erfolgreiche Imple-

mentierungen verbinden in der Regel präzises Prompt- Engineering, eine durchdachte Daten- und Tool-Integration, klare Governance-Rahmen sowie einen konsequenten Review- und Qualitätssicherungsprozess. Im Folgenden stellen wir Ansätze vor, die sich besonders bewährt haben.

Berichte in logische, kleine Textbausteine zerlegen statt End-to-End-Generierung

In der Regel ist es nicht zielführend, einen vollständigen Bericht in einem Schritt generieren zu lassen. Besser ist die Aufteilung in kleinere, fachlich kohärente Pas sagen (z. B. Unterabschnitte, Treiberkommentare, Me →Fachartikel 45 thodenboxen). Dadurch können Struktur, Tonalität und erlaubte Inhalte pro Baustein präzise gesteuert werden; zugleich werden erforderliche Reviews deutlich ein facher.

Standardisierte Prompt-Templates mit klaren Leitplanken

Ein robustes Template definiert u. a.: Zielgruppe, gewünschte Länge, Stil (z. B. „präzise, neutral, ohne Mar keting“), erlaubte/unerlaubte Aussagen, verpflichtende Begriffe, Formatvorgaben und den Umgang mit Unsi cherheit. Zudem wird festgelegt, welche Tools per Func tion Calling zu verwenden sind (z. B. Berechnungen/ Plausibilitäten) und welche Ausgabevarianten zulässig sind – etwa „Fall A/B/C“, sodass der Textbaustein nur in vordefinierten Fällen ausgegeben wird. Der Grad an Leitplanken ist dabei ein bewusster Trade-off zwischen Freiheit und Kontrolle: Mehr Vorgaben reduzieren die Varianz und erhöhen die Reproduzierbarkeit, insbesondere über Perioden hinweg.

Lernen aus der Vergangenheit durch Beispiele („Few-Shot-Prompting“)

Historische Input-Output-Paare eignen sich hervorragend als Anker: Beispielsweise können die letzten fünf Jahresversionen einer Textpassage (inkl. zugehöriger Inputdaten) in den Prompt aufgenommen werden. Das Modell erkennt dann die gewünschte Struktur, den Ton und typische Formulierungen. Alternativ können mehrere Tochtergesellschaften als Beispiele genutzt werden, um gruppenweit konsistente, aber einheitsspezifisch parametrisierte Texte zu erzeugen.

Fine-Tuning oder domänenspezifische Modelle

Liegen nicht nur wenige, sondern eher mehrere Dutzend (oder mehr) qualitativ guter historischer Input-Output Paare vor, kann ein Fine-Tuning eines LLMs sinnvoll sein. Dadurch wird das Modell stärker auf Terminologie, Stil und typische Argumentationsmuster der Organisation angepasst. In vielen Fällen reicht jedoch bereits ein gutes Few-Shot-Prompting, sodass Fine-Tuning eine Option, aber kein Muss ist.

Retrieval-Augmented Generation (RAG) und „Single Source of Truth“ für Fakten

Um Halluzinationen zu reduzieren, sollten Fakten konsequent aus kontrollierten, freigegebenen Quellen bereitgestellt werden – etwa aus Datenbanken, einem Dokumentenmanagementsystem oder einer zentralen Knowledge Base. Das LLM dient dann primär als For mulierungs- und Strukturierungsinstanz: Es schreibt den Text auf Basis der gelieferten Inhalte, statt Fakten zu „er raten“. Voraussetzung für verlässliche Ergebnisse sind Versionierung, eindeutige Referenzen (z. B. Dokument ID/Stand) und klare Zuständigkeiten dafür, welche Quelle als „Single Source of Truth“ gilt.

Fachvokabular und Glossar aktiv einbeziehen

Versicherungsspezifische Begriffe und Abkürzungen sollten explizit bereitgestellt werden – entweder im Prompt (als kompaktes Glossar je Bericht) oder über ein angebundenes Nachschlagewerk. Zusätzlich bewährt sich eine „Terminologie-Policy“: erlaubte Abkürzungen, definierte Schreibweisen und Regeln, wann Begriffe ausgeschrieben werden müssen. Darüber hinaus kann tiefes (aktuarielles) Wissen ebenfalls einbezogen wer den, falls bei den bereits erwähnten Ansätzen die Not wendigkeit besteht.

Modellwahl und Architektur bewusst treffen (Kosten, Performance, Deployment, Risiko)

Nicht jeder Use Case erfordert ein besonders großes und damit kostenintensives LLM. Für stark strukturierte, wiederkehrende Texte kann ein kleineres Modell aus reichen – insbesondere, wenn gute Beispiele, RAG, klare Templates oder ein domänenspezifisches Fine-Tuning eingesetzt werden. Auch das Deployment ist Teil der Lösung: Cloud-Plattformen (z. B. in kontrollierten Unter nehmensumgebungen) versus lokale Ausführung auf eigener Hardware – jeweils mit Auswirkungen auf Daten schutz, Latenz, Kosten und Governance.

Function Calling / Tool-Integration für deterministische Berechnungen und Checks

Für Zahlenlogik sollte das LLM nicht „rechnen“, sondern Tools nutzen: etwa eine bereitgestellte Python-Funktion, die Kennzahlen berechnet, Rundungslogiken konsistent anwendet oder Plausibilitätschecks durchführt. Beispiel: Eine Funktion nimmt Zähler und Nenner entgegen und liefert eine Quote als Prozentwert mit definierter Run dung; das Modell darf den Wert nur verwenden, nicht selbst berechnen. Darüber hinaus lassen sich mit Tools auch Datenbanken abfragen, Validierungsregeln anwen den oder Referenztabellen konsistent einbinden.

Automatisierte Validierung und Red-Flag-Regeln vor dem Review

Neben Tool-basiertem Rechnen sind formale Prüfregeln hilfreich: Stimmen Summen und Prozentwerte? Sind Vorzeichen plausibel? Sind alle Verweise auf Tabellen/ Kapitel korrekt? Enthält der Text Pflichtpassagen (z. B. Disclaimer)? Solche Checks lassen sich vor dem menschlichen Review automatisiert ausführen, um den Review auf fachliche Substanz zu fokussieren.

Human-in-the-Loop als verpflichtendes Prozess- design (Verantwortlichkeit bleibt beim Menschen)

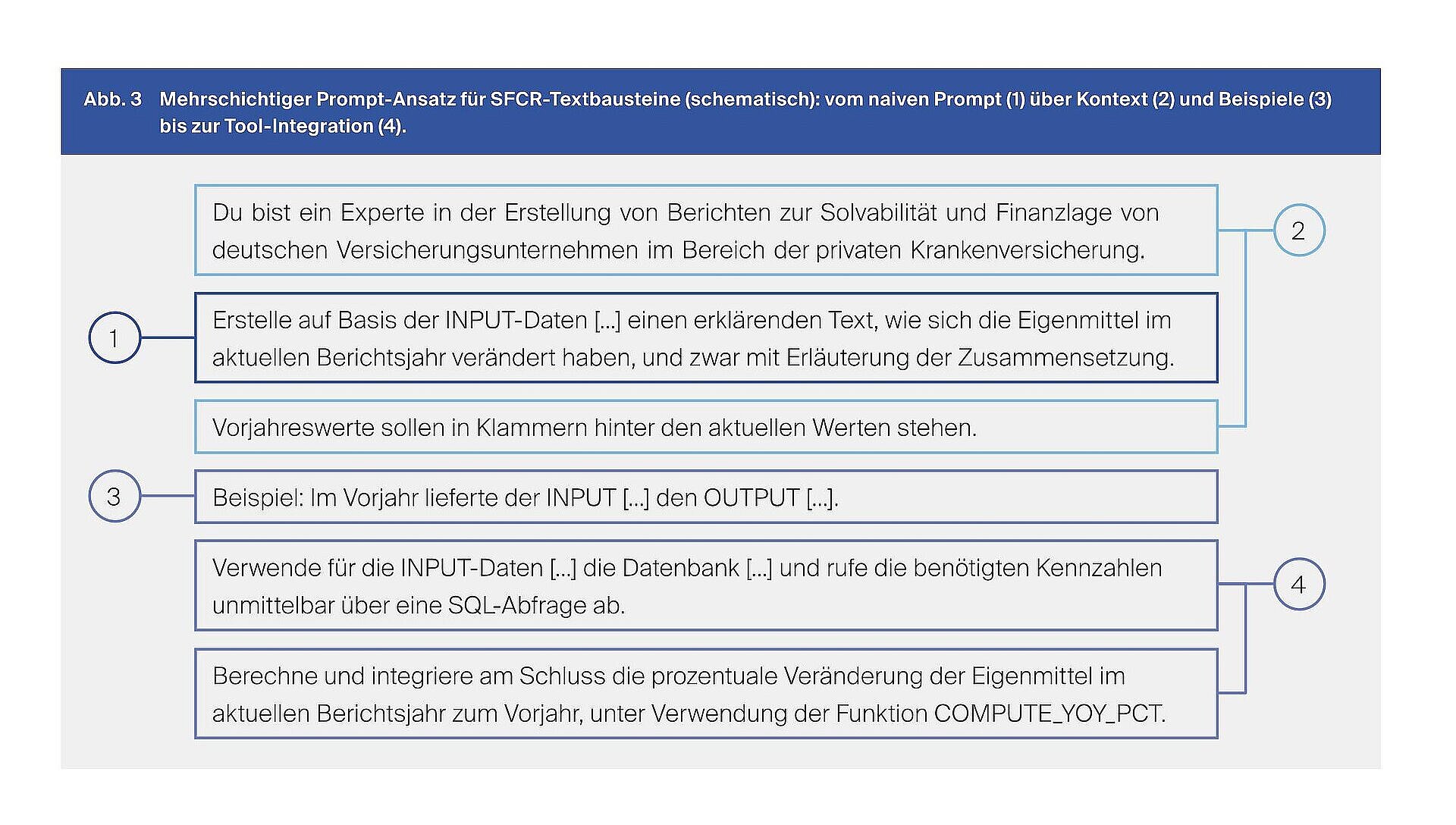

Eine praxistaugliche Zielarchitektur definiert klar: Das LLM erstellt Entwürfe, Menschen prüfen und verantworten Inhalte. Das beinhaltet Rollen (Ersteller, Reviewer, Freigeber), Mindestprüfungen (z. B. Zahlenabgleich gegen Datenquelle) und ein nachvollziehbares Änderungsprotokoll. In der Praxis hat sich für die Berichterstellung ein mehr schichtiger Prompt-Ansatz bewährt: Ein einfacher Aus gangsprompt wird schrittweise um Kontext (z. B. Berichts typ, Zielgruppe, Abschnittszweck), Beispiele/Referenztexte.

und schließlich um Tools ergänzt, etwa für Datenabfragen, Berechnungen oder Validierungen. Dadurch verschiebt sich die Rolle des LLMs von einer „freien Textgenerierung“ hin zu einer kontrollierten Formulierung auf Basis definierter Inputs. Abbildung 3 illustriert dieses Prinzip anhand sche matischer Beispielprompts für SFCR-Textbausteine.

Fazit & Ausblick

Wir sind überzeugt, dass GenAI die Berichterstellung in Versicherungsunternehmen nachhaltig verändern wird – nicht als Ersatz für fachliche Verantwortung, sondern als produktives Werkzeug zur Beschleunigung, Harmonisierung und Qualitätssteigerung. Gerade in wiederkehrenden Reporting-Prozessen mit klarer Struktur und hohem manuellem Aufwand kann GenAI erhebliche Effizienzpotenziale heben – vorausgesetzt, Berechnungen und Faktenquellen sind deterministisch abgesichert, Halluzinationsrisiken werden systematisch begrenzt und Governance-Anforde rungen konsequent erfüllt.

Entscheidend ist dabei ein realistisches Zielbild: Der Mensch bleibt „am Steuer“. GenAI liefert Entwürfe, alter native Formulierungen, Plausibilitäts- und Konsistenzhinweise – doch die fachliche Prüfung, die finale Freigabe und die Verantwortung verbleiben bei den Aktuarinnen und Aktuaren bzw. den verantwortlichen Funktionen. In diesem Sinne bringt es ein Zitat des ehemaligen IAA-Präsidenten Charles Cowling treffend auf den Punkt: „AI will not replace actuaries, but actuaries with AI will replace actuaries wit hout AI.“

Ein pragmatischer Einstieg über die Berichterstellung stiftet dabei nicht nur unmittelbaren Nutzen. Er schafft zugleich Kompetenzen, Standards und technische Grundlagen, um weitere – anspruchsvollere – aktuarielle Anwendungsfälle verantwortungsvoll zu erschließen. Damit wird GenAI zu einem strategischen Enabler für die Weiterentwicklung aktuarieller Arbeitsweisen und für eine moderne, effiziente und qualitätsgesicherte Berichtskultur.