Die Rolle aktuarieller Expertise für einen erklärbaren und diskriminierungsfreien KI-Einsatz

Dies ist keine rein technische Aufgabe, sondern erfordert eine interdisziplinäre Zusammenarbeit, bei der Aktuarinnen und Aktuare eine Schlüsselrolle spielen.

Chancen und Risiken

Der Versicherungsbranche bietet Künstliche Intelligenz (KI) großes Potenzial, ihre Geschäftsprozesse effizienter zu gestalten, neue Produkte zu entwickeln und die Kundenerfahrung zu verbessern. Gleichzeitig birgt KI Risiken. Die zugrunde liegenden Modelle gelten oft als „Black Box“, da es gegenüber klassischen statischen Verfahren aufwendiger ist, Transparenz sicherzustellen. Ohne Transparenz besteht die Gefahr, dass Entscheidungen, etwa bei der Risikobewertung oder im Kundenservice, schwer erklärbar sind, was das Vertrauen in KI-Systeme schwächt.

Ein weiteres Risiko ist die unbewusste Diskriminierung durch verzerrte Daten (sog. Bias). KI-Modelle lernen meist aus historischen Daten, die gesellschaftliche Verhaltensweisen, Normen und Ungleichheiten widerspiegeln können. Ohne Maßnahmen gegen Bias könnten benachteiligte Gruppen systematisch diskriminiert werden, was unter Umständen die Einhaltung der regulatorischen Vorgaben gefährdet und die gesellschaftliche Verantwortung der Versicherer unterminiert.

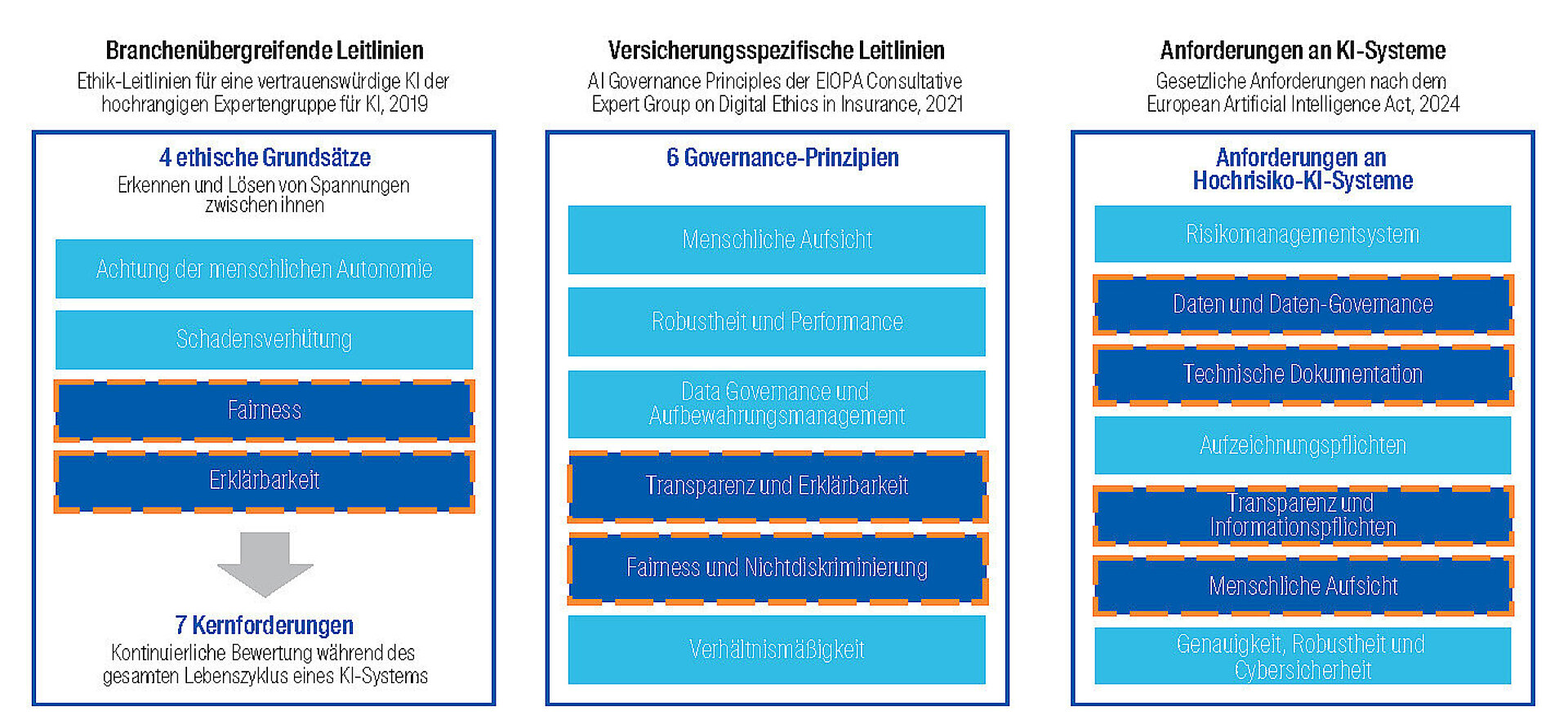

Die aus der Datenwissenschaft stammenden Disziplinen „Explainable AI“ und „AI Fairness“ bieten Werkzeuge für erklärbare und diskriminierungsfreie KI. Sie betten sich ein in die verschiedenen Leitlinien für verantwortungsvollen KI-Einsatz, die europaweit oder spezifisch für die Versicherungsbranche entwickelt wurden (s. Abbildung).

Transparenz und Erklärbarkeit

Wichtig für die Akzeptanz komplexer Modelle ist ihre Erklärbarkeit. Erklärbarkeit ist ein vielschichtiges Konzept, das weder in der Literatur noch in der Praxis formal einheitlich definiert ist. Gängige Definitionen zielen darauf ab, dass ein Modell erklärbar ist, wenn sein internes Verhalten vom Menschen verstanden werden kann. Der erforderliche Grad der Erklärbarkeit hängt von zwei Faktoren ab: zum einen vom Adressaten der Erklärung, da jeder Adressat unterschiedliche Interessen und Erfahrungen hat. Beispielsweise interessiert einen Versicherungsnehmer, welche Faktoren seine individuelle Prämie beeinflussen, während für ein Unternehmen das globale Modellverhalten und die Tarifauskömmlichkeit im Fokus stehen. Zum anderen hängt der erforderliche Grad der Erklärbarkeit vom Risiko des jeweiligen Anwendungsfalls ab. Wenn etwa ein Versicherungsnehmer im Schadenfall direkt mit einem KI-System interagiert, ist er nicht nur über diesen Umstand aufzuklären (sog. Transparenzpflicht), sondern das Versicherungsunternehmen hat strengere Anforderungen bei Entwicklung, Dokumentation und Erklärbarkeit zu erfüllen, als wenn das KI-System lediglich unternehmensintern genutzt wird.

Diese Risikoperspektive spiegelt sich auch in der europäischen KI-Verordnung wider. Dass, vereinfacht gesagt, jede von einem KI-System getroffene Entscheidung für Menschen verständlich und rückverfolgbar sein soll, betonte 2019 bereits die KI-Expertenkommission der Europäischen Kommission, und auch die entsprechende EIOPA-Expertengruppe forderte, stets den Einfluss von Merkmalen auf Ergebnisse und deren Wechselwirkungen erklären zu können. Versicherer nutzen dafür Techniken der „Explainable Artificial Intelligence“, sogenannte „Erklärbarkeitsmethoden“, die zum Beispiel bei komplexen neuronalen Netzen zeigen, welche Merkmale ein Ereignis wie stark beeinflussen – etwa den Zusammenhang zwischen Alter, Beruf und Prämienhöhe einer Berufsunfähigkeitsversicherung.

Bias, Diskriminierung und Fairness

Technologieunabhängig hat die Anwendung von KI in der Versicherung im Einklang mit dem Allgemeinen Gleichbehandlungsgesetz (AGG) zu erfolgen. Eine Ungleichbehandlung z. B. anhand von Geschlecht oder ethnischer Herkunft stellt im rechtlichen Sinne immer eine verbotene Diskriminierung dar. Bestimmte Merkmale wie beispielsweise Alter dürfen jedoch zur Risikobewertung herangezogen werden, auch in komplexen KI-Modellen, und damit im statistischen Sinne diskriminieren. Die europäische KI-Verordnung gibt dafür klare Vorgaben. Insbesondere in der Risikobewertung und Preisbildung bei Kranken- und Lebensversicherungen sind Maßnahmen zur Erkennung und Minimierung möglicher Verzerrungen (sog. Bias) erforderlich. Dazu gehört auch die Überprüfung der zugrunde liegenden Datensätze hinsichtlich ihrer Menge, Qualität und Eignung.

Versicherer setzen hierzu organisatorische und technische Maßnahmen um. Mitarbeitende werden sowohl hinsichtlich der gesetzlichen Vorgaben als auch der gesellschaftlichen Verantwortung sensibilisiert. Vielfalt in Entwicklerteams, eine effiziente Governance und Integration in das bestehende Risikomanagement helfen, Bias frühzeitig zu erkennen und abzuschwächen, damit KI-Systeme nicht (unerlaubt) diskriminieren, sondern statistisch möglichst objektive Entscheidungen treffen. In der Literatur spricht man von einer hohen algorithmischen Fairness. Sogenannte „Fairness-Metriken“ messen, wie stark sich Vorhersagen und Fehler eines Modells zwischen den Ausprägungen eines Merkmals unterscheiden. So lässt sich beispielsweise leichter erkennen, dass die Nutzung der Schuhgröße zur Tarifierung einer Berufsunfähigkeitsversicherung zu einer Diskriminierung von Männern führen würde.

Die Nutzung solcher Techniken ist in der Branche noch nicht umfänglich etabliert. Ein verantwortungsvoller Umgang inkludiert nicht nur die Messung statischer Objektivität, sondern auch die Betrachtung des gesamten Lebenszyklus eines KI-Systems – von der Datenherkunft bis zur Integration in den Geschäftsprozess.

Rolle der Aktuarinnen und Aktuare

Beim Einsatz von KI ist eine ausgewogene Abwägung zwischen Erklärbarkeit, algorithmischer Fairness und Vorhersagegüte entscheidend. Da sich aber bisher keine einheitlichen Grade und Definitionen in Literatur und Praxis durchgesetzt haben, sind für einen verantwortungsvollen KI-Einsatz im Versicherungskontext sowohl eine umfassende Daten- und Modellierungsexpertise als auch ein tiefes Wissen über die versicherungsspezifischen Besonderheiten sowie die gesetzlichen Anforderungen essenziell. Aktuarinnen und Aktuare als Hüter des Versichertenkollektivs bringen dieses Wissen mit und sind erfahren darin, im Spannungsfeld zwischen Versicherten, Versicherern und Aufsicht zu handeln. Die Mitglieder der Deutschen Aktuarvereinigung e.V. (DAV) profitieren zudem von zahlreichen Ausbildungsformaten und Berichten in KI-Theorie und KI-Praxis. Durch die Zusammenarbeit von Daten- und Aktuarwissenschaften gelingt ein verantwortungsvoller KI-Einsatz in der Versicherung und die gesteckten Ziele wie höhere Kundenzufriedenheit, effizientere Geschäftsprozesse und bessere Risikobewertung können erreicht werden.